空间智能计算的挑战与机遇

谈宜勇博士:武汉大学,美国佛罗里达大学博士。发表十余篇人工智能,计算机视觉,3D成像领域学术论文。在美国数家世界500强公司从事医学3D重建分析,2D&3D计算机视觉,AI及AI芯片, AR/VR空间计算等领域算法研发,获十余项发明专利. 研发的AI机器视觉视频模型,手术机器人,空间智能计算增强现实系统产品在美国被企业医院广泛使用。

第一稿(版权所有,转载请联系作者),十万个为什么 3.0 编委会 , 2024年 6 月1日,于硅谷,美国

基于宇宙大爆炸理论,空间在宇宙诞生暴胀中最先产生,源于空间的真空能量是空间的基本属性和宇宙常数的来源,也可能是现在仍在维持宇宙空间加速度膨胀占宇宙总质能近70%的暗能量的根本来源。 空间暴胀的真空能量产生了物质,基于物质的生命意识产生后, 空间作为宇宙之源并一直是物质和生命意识智能的共同载体。三维空间在人类视觉神经系统里被计算理解内化产生的空间意识自然成为外部物质和内我智能意识联系相互作用的桥梁。基于视觉空间计算的生命空间意识,人类智能的空间意识和人工智能三者紧密相关,是共同推进下一文明阶段的三大鼎足。 实现混合文明空间计算的不同空间阶段依次为:人类虚拟元宇宙空间,人类虚拟和现实混合空间,机器人虚拟元宇宙和现实混合空间,机器人和人类互动于虚拟和现实的混合空间。基于人工智能(Artificial Intelligence-AI)的空间计算是支撑建立未来机器人和人类共存混合文明不同空间阶段的基本计算需要。要实现未来的混合文明,未来地球几何形态需要逐渐数字化,并从而提供训练机器人和大通用空间智能模型的基础数据。大通用空间智能模型支持的人形机器人加入并融入人类日常生活,实时采集的空间形态数据也反过来扩展更新数字地球空间人类社会属性的广度,深度和实时度。机器人进入人类社会日常后,成为真正的人类帮手,逐渐成为人类文明日常生活的一部分,和自动驾驶一道扩展室内和室外的空间几何数据。空间计算通用大模型将是达到下一高度的地球人类混合现实文明(地球全空间数字孪生与真实地球的混合; 机器人作为人类数字孪生和人类的混合)的标志性奇点。科学家和工程师们在全范围地球信息通用空间计算的深入实现和机器人空间自主技术的进步将不断正反馈迭代加速混合文明的演化过程,从而产生奇点式跳跃发展。本文试图通过一系列与宇宙自然空间和人类空间智能计算相关的为什么入手,从自然生物空间意识和人类空间计算的演化角度阐述空间被产生于自身的物质和生命感受理解138亿年波澜壮阔的时间空间简史,深入探讨人形空间自主机器人成为在现实空间有切实行动执行力的AI助手(区别于只是听说读写做信息交流的AI应用)的最终实现以及元宇宙数字孪生地球的最终建立这两个未来科技文明至关重要激动人心的进展和方向。

为什么空间是宇宙之始,是能量,时间,物质和意识的母载体?

从第一次宇宙大爆炸宇宙几乎是时间原点空间暴胀开始,空间与时间肩并肩,只争朝夕地努力以加速度完成自己的膨胀和孕育在空间内可以理解空间自身的智慧生命。首先孕育的主要是没有静止质量没有时间但有能量的不带电轻子光子等基本粒子,进一步产生可以感知空间和时间有静止质量的物质和最终如母空间一样可以承载物质,意识,能量和时间四位一体的生命。从一定意义上来说,人类智慧对维度的理解也是以加速度在日益深刻地不停发生并让母空间欣喜不已的。以宇宙空间已经经历的时间尺度来看,空间和自己孕育的生命的全方位相互作用的历史奇点立刻正即将发生。

宇宙时间原点没有空间,能量,时间和物质,可谓四大皆空,四大皆空中最先产生空间后才开始产生能量,物质和被有效静止质量感受的时间。空间首先在宇宙开始后10-36秒中一个体积无限小没有空间维度的点无中生有地暴胀期成长自己,这是空间本身没有物质参与的急速成长,强核力从电弱力中分离出来,最终超过初始尺寸的1060倍。这一切都在 10-32秒内瞬间完成,由于空间的超光速爆炸式膨胀,短时间内本应一起再次湮灭的粒子会被移动得距离彼此远到湮灭不能及时发生,物质从能量指数爆炸暴胀中被有效地创造出来。 空间和能量一起作用产生最初1秒强子时期和短暂10秒的轻子时期后,宇宙有了自己的第一束光。光的诞生是空间中开启未来的里程碑事件,自光诞生之始就一直是与空间能量物质意识紧密关联的纽带: 在空间中与带电的质子、电子和核发生交互作用逐渐帮助产生物质, 作为空间物质相互作用和能量交换的转播介质, 作为地球生命主要能量来源,最终也在生命视觉产生后作为空间被生命理解的空间形态信息传播介质,生命意识发生的时刻也同时有脑电磁波光子的产生。光子作为宇宙主要能量形式与宇宙空间耦合始于宇宙时间10秒终止于38万年,光子时期宇宙是一个光几乎全被“禁锢”不透明的浓密电浆宇宙。 对光速运动的基本粒子的光子来说,时间不会流逝,运动方向的距离坍缩到零导致一个维度消失,空间在光子世界里是静止而且是坍缩为二维的。 假如宇宙爆炸有一束光经历宇宙138亿年演化直接被人类以微波背景辐射捕获,根据相对论,时间对于这束光来说是没有意义的,这束光只能感受产生和湮灭两个事件同时发生。同样,在漫长旅途与空间物质作用过程的光也只能感受两个事件(产生和湮灭)同时发生,至于折射反射散射湮灭后是否产生新的光子,是原来光子无关也无法感知的事件。光速运行的光子没有时间等同于光子自己的产生和光子自己的湮灭是共存态是一不是二地处于类似薛定谔猫的状态。因此可以说光和以光速运行的基本粒子对空间的感知是无时间维度参与的静止二维理解。另一方面又可以说有些光子不生不灭与宇宙同在,任凭在宇宙中翱翔138亿年,所经历没有被湮灭前的宇宙空间尺度在光子看来皆为整个宇宙历史不分前后同时完成完全没有时间差别叠加态的二维全息投影,可以说几乎全部物质个体(几乎全部是光速运动的光子,光子对重子的比率大约是10−9)对空间的感知是两个维度的多态叠加无时间的静态呈现。

宇宙温度降低之后得以产生重子,大爆炸约7万年后逐渐不断产生物质进入物质主导时期,在这个时期,非相对论性的物质与相对论性的辐射在密度上逐渐平衡,并进入爆炸之后约38万年开始的复合期。 自低于光速运动的粒子开始,有了物质在变化空间中有时间维度的运动, 物质和空间共存让时间开始有了真正的意义。 重子感受的作用是一个和自身大小一样大小近于零维点空间里的基本粒子在时间维度上成分增减和场强度变化。宇宙渐渐冷下来,氢原子和氦原子等轻原子以气态等离子态聚集经过数亿年之久的黑暗时期, 终于迎来了第一颗恒星的产生,宇宙又明亮起来, 超星爆炸,中子星合并, 逐渐出现产生更多的重原子和分子,经历约5亿年终于产生了宏观意义上的固体聚集形式:宇宙尘埃,彗星,行星,星系。空间不再只有无固定大小的气态等离子态的点, 开始有了三维恒定空间形状大小宏观广度呈现的物质存在形式,为更复杂结构和生命的产生铺平了康庄大道,以空间换时间地进入生物演化的空间并行加速度模式[1]。

为什么对空间的理解是生物智能进化紧密相关的催化剂,往昔寒武纪空间视觉理解触发的生物空间形态大爆炸是否预示未来将会发生空间智能计算触发的智能形式大爆炸?

根据宇宙学标准模型做出的推演推断无法从宇宙学可观测边界或全部空间外部事物的角度来整体理解空间,空间在自己成长边界之外也无法被感知和欣赏,广袤奇美的空间不应孤老而终,值得也应该被注视欣赏, 在空间之内产生能理解空间的物质成为空间自诞生后努力发展的必然。 空间产生后的100亿年之后,宇宙空间完成了物质各种形态的舞台准备, 为生命舞者提供了有广度复杂度的稳定物质环境和空间载体。 有静止质量的物质从在空间中诞生那一刻开始,就一直努力跋涉在感知理解创造自己的本源母空间的漫长寻根朝圣之旅。

随着时空的演化,就我们人类目前所知,空间被自身孕育的物质所理解的奇迹至少在一颗不停努力运气极好的行星上成功发生了,这颗幸运之星就是我们的蓝色地球! 宇宙空间诞生约100亿年后地球生命形成的史诗终于开始了它波澜壮阔的篇章: 最开始,单细胞原核生物被限制在多孔金属硫化物的孔隙中,对空间的体验是固定单点的。之后,生命可以游离于一个单细胞大小的空间点,对空间还处于零维度的感知。这一单细胞过程持续约三十亿年, 直到五到十亿年前,真核多细胞生命才第一次真正意义上可以感知物理量(压力,浓度,温度)在自己身体不同部位的区别。植物能感知不同空间并完成自身的分化生长 ,顶部有阳光长叶,底部有水分长根。 动物第一次主动在空间里趋利避害的需求中进化出对物理特性的感知:触觉 (压力传感器), 听觉(声波压力传感器),味觉和嗅觉(化学分子传感器) 。在所有这些觉受之中,其他觉受在空间的感知和定位能力都远不如视觉(基于宇宙最快电磁波的直线定位传感,电磁波本身在宇宙初期也帮助产生物质并和物质特性紧密相连)。 视觉对大脑后处理和并行推行处理的速度有远高于其他感官的要求,极大的促进了整个中枢神经系统的智能进化。 寒武纪生物大爆发的一种假说就是有化石证据的三叶虫视觉系统的出现是生命多样化的内驱力。 视觉的出现给了生命的旅程一束通天之光,如魔法闪电般开启了空间被自身产生的生命受体在三维空间中精确理解的可能性 。生物与空间的交互理解约70%的感受都在眼中,使得进入中枢神经系统的信息量至少多了一个数量级的信息量, 生物在空间的动态竞争空前激烈,基因在空间生存压力的加速变异, 促使生物多样性的爆发和生物大脑加速演化。动物从物体之间空间关系和位置的变化中获得识别,预测,洞察,计划等种种意识智能能力,在动态三维空间中分析出目标和需要绕过的障碍等等空间意识,这些都是形成高阶智能的基础奠基素材。生物智能的演化同时极大地增强了物种间的竞争强度,视觉的发展使得物种必须以更快的速度或更优化的策略来面对动态改变的三维空间场景,运动相关的肌肉骨骼平衡系统也同时得以高速发展。 视觉也几乎成为在光亮条件下动物的标配基因,可以几乎肯定的说,眼睛的产生是生物进化和智能进化的里程碑。因为三维空间感知的硬性需求和强化的生存求偶选择,使得寒武纪生物对形态,颜色和敏捷应激成了天然的刚需,从而加速了生物进化和生物物种大爆炸,几乎在生物之光引入地球日历的一瞬间后奠定产生了现有已知地球生物所有物种的祖先[2]。

视觉的空间理解和智能及意识紧密相关,可以认为是研究智能的“冰山一角”和自然出发点。对人脑视觉的分析可以帮助我们一窥从三叶虫产生视觉以来近5亿年不停演化的近乎巅峰之作。人类视网膜自外向内分为10层,厚度只有0.5毫米左右,但它却包含大约2亿个神经元。 视神经对大脑后处理的速度和并行处理有远高于其他感官的要求。大脑接近一半的能耗和三分之二脑电信号是源于视觉系统 。人类大脑也是高效的视觉系统, 大脑内有约1000亿个神经元,但在任何特定时候,通常只有1% 约10亿个神经元处于运行频率大概只有8-35赫兹的活跃状态 ,视觉处理的能耗不到10瓦特。 以人类视觉系统的计算机实现为例,即使不包含对每一帧图像光能到神经信号转变,二维到三维空间合成及图像的视觉理解处理,仅仅满足大脑处理的高分辨率渲染 (可视像素达到了5.76亿高帧频图像是现在4k显示器的像素值的近70倍且每个像素细胞动态范围实时分立可调 )也需要同等至少四个有24G 内存的RTX3090显卡的算力 ,也就是约大脑100倍以上的能耗,可见光电成像系统和视频处理芯片GPU 还远远没有达到人眼和大脑视觉处理的效率水平。生物从被动感知空间,到由对空间真实理解产生自我个体的内化定义,转变为对外化空间的智能理解,都在视觉系统的演化中魔术般奇迹实现了。机器人要成为人工智能有行动判断能力的人形载体,对物理空间的理解是不可跳过的一个重要阶段。外延空间内化到生物感知形成的空间边界,看到内化为对环境的洞见, 空间意识开始内化为微小生命个体的一部分,动物体能智能进化为最初始与外界空间隔离的“我”及自我意识的形成,这一路生命意识之旅都将是人工智能人形机器人成为人类社会的一种安全存在形式所需要借鉴的[3] 。

为什么空间计算可以从二维采样中构建三维空间并实现四维模拟,可以为人类拓展维度认知和文明等级?

首先,物理量测量在测量时刻是对物理量的一个维度限制,是高维物理量在低维的投影,因而三维世界的感知测量是在至少低一维度的传感器中测量。我们身处三维世界,这是在物理学、力学和其他科学领域的理论和公式已经暗示佐证的。例如万有引力和库伦定律等大多数物理定律物理量强度衰减是以距离的平方成反比的, 如果我们生活在四维世界则应该是距离的立方成反比的。由于物理限制传感器本身换能器和供电散热传输数据需要至少一个维度,真正意义上的空间三维传感器和三维显示器还有工程上的技术挑战。传感器检测环境中某些物理量温度、压力、光照等需要作用于传感器的接触面的,目前传感器在同一时刻只能检测到零维点一维线或二维面的信息,而不能直接检测到三维的物理量信息。三维是后期计算加工的产物,如光飞行时间景深传感器(如激光雷达或激光测距等)用检测到的一维二维信号可以反推重建到三维的信息,但这只是对三维数据空间的构建,而不是三维数据真正直接的测量[4]。

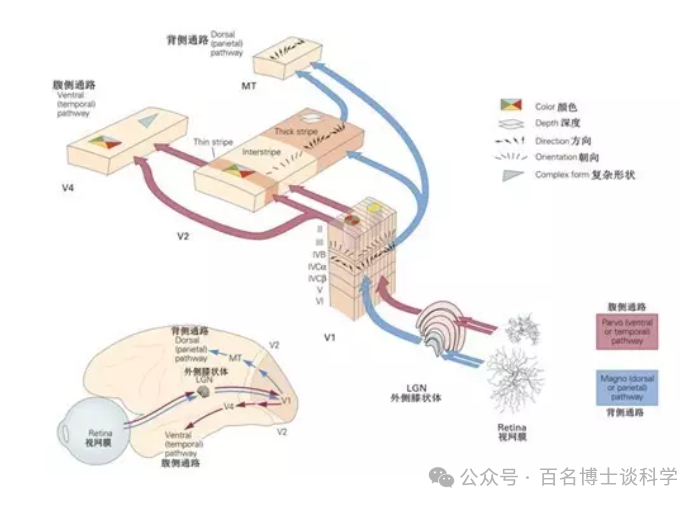

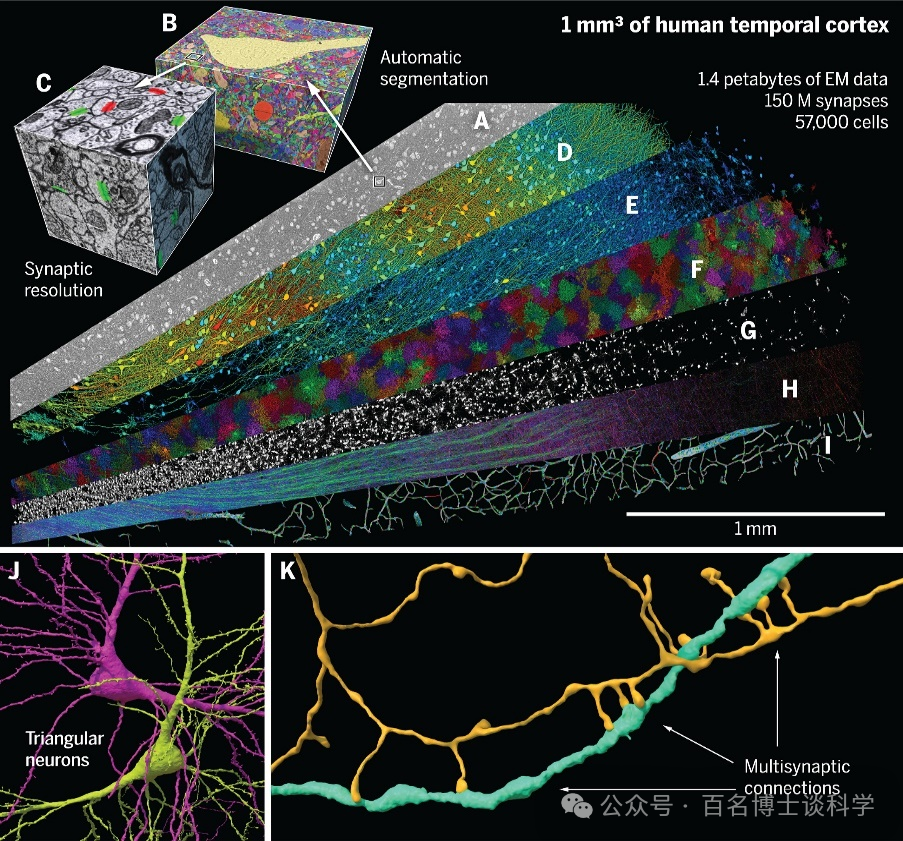

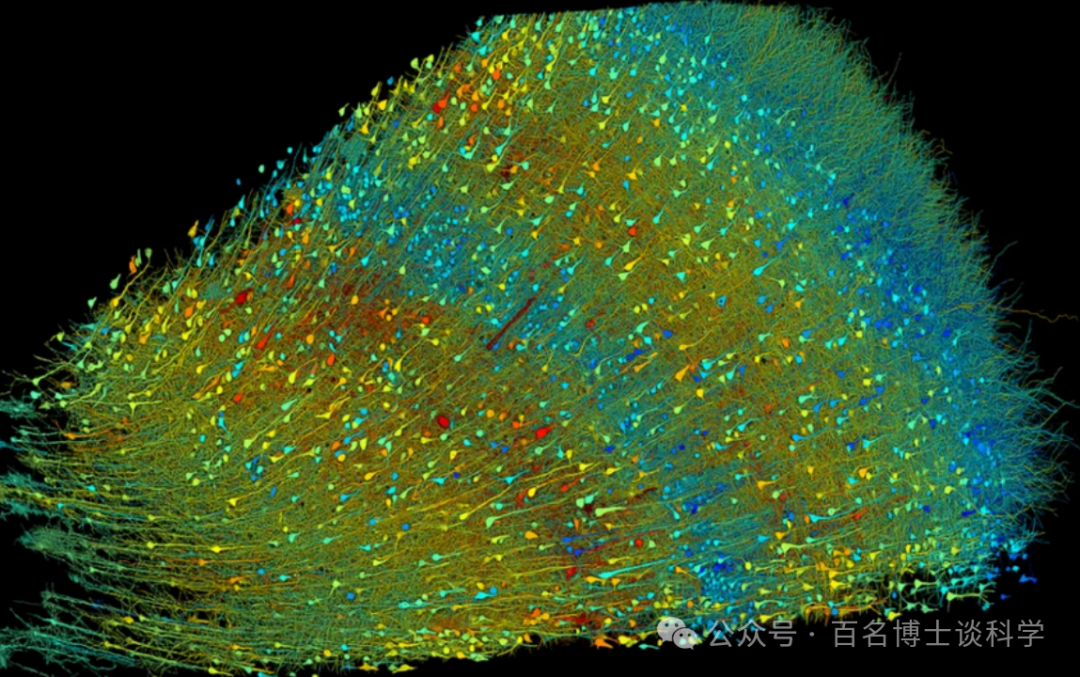

生物视觉真实大视角高分辨率景深三维图像也是从二维视网膜信号通过视觉系统后处理到三维的重建。 人类视觉系统产生三维体验主要通过人眼双眼视差实现。人眼通过计算两幅二维视网膜图的差异来计算空间距离,基本原理是远处物体进入两眼入射线近乎平行,以此在两眼视网膜聚焦成像位置接近,同一物体在两眼因入射角度的差异产生在两眼视网膜投影的聚焦位置的巨大差别可能用来确定物体与眼镜的相对距离。对大脑V1~V5五层视觉分析系统认识目前为止还比较初步,仅仅是通过解剖,脑电图和核磁共振对V1系统有个低分辨率模糊的机制理解。 V1、V2、V4 等组成的腹侧通路主要处理物体形状、颜色等信息;V1、V2、V5 等组成的背侧通路主要负责对运动等信息的感知,两个回路之间通讯信息整合并合成理解三维运动的机制现在并没有确切的答案 。如下图引用2024科学杂志的一项研究 [5] ,从人类大脑视觉系统里中学习的主要瓶颈在于:由于视神经脑科学的数据采集仪器分辨率灵敏度的限制,皮层V1层动辄亿计神经元活动信号和更深度层级信号的卷积融合,因此科学家无法分辨区分不同层级,暂时只能停留在粗浅的理解阶段,很难给空间智能通用大几何模型提供可操作性的视觉理论指导。另一方面,空间智能通用模型如果能逐渐逼近人脑,用计算算法的不停试错改进,也同时给人类提供了理解自身视觉系统空间意识产生流程的间接研究途径。 如从长期现实经验学习的角度,进化演化本能产生的空间常识是如何在瞬间整合到每一帧人类视觉视网膜图像,人类视觉为何能实时在超大视野中依然动态平衡关注点,人类视觉如何高清分辨关注基于自然常识判断的最重要细节,人类视觉几近完美同时解决全局优化和局部最优矛盾体的实时权衡分辨率取舍,人类视觉如何把接受的二维图像高效转换为稳定真实高分辨率的三维感知 ,这一系列的科学界待解之谜有望在借助指数级算力进步而空前发展的空间智能计算进展中得以更完善地诠释。

图一(群):大脑视觉回路简图及耗时十年于2024年完成的视觉回路颞叶区1mm3切片层级神经元纳米分辨率电子显微镜图[5-6]。

空间计算目前还不能实现等同人类视觉二维到三维重建,人工智能模型因三维数据匮乏无法在通用空间达到高质量标准。 目前计算机视觉深度算法主要基于运动 和视差 并依赖于场景中的特征丰度和对应度,对数据在不同光强和雨雪天气的误差的鲁棒性很不理想。 自动驾驶,元宇宙的应用无法达到技术成熟接近人类视觉对空间的理解和体验的真切感。 同时计算机算法与人类大脑视觉系统也有一些本质上的鸿沟。 计算机空间计算使用局部离散数学点云或像素RGB向量化作为主要基于解析几何的代数数值算法的输入,同时计算机硬件计算也是存取器间的向量批处理计算, 目前无法直接基于“连续数学”如微分几何或立体欧几里得几何概念构建分析算法去真正产生有全局空间的意识理解。 人脑一般认为是近似模拟电路的连续数学机制,与离散数字化的计算机电路可能有很多不同之处,因而人脑有几何精确高分辨率超低能耗的想象力和视觉理解力,能否用离散数学和计算机采样计算来无限接近连续化空间思维的人脑也是科学家工程师拭目以待的突破。 关于人脑运转是否有量子计算的一些机制这一问题,当前的科学研究尚不存在统一的定论。一些科学家推测,人脑神经元的功能可能与量子过程有关,因此是否有只有通过量子计算机的发展才能实现人脑的某些视觉,空间意识和思考机能还有待商榷。 目前空间计算应用设备的三维渲染与人脑对真实三维世界感知的巨大差异常常直接导致多数人会在使用增强现实(AR) 虚拟现实 (VR) 的过程中产生失去平衡感的不适甚至眩晕。明尼苏达大学运动学家托马斯·斯托弗雷根 (Thomas Stoffregen) 研究显示, 目前四维40%~70%的VR 使用者仅仅 15 分钟后就会出现晕动症,极大阻碍了空间计算设备广泛被消费者接受和频繁使用,采集足够三维场景数据支持空间通用大模型的训练迭代进步[7]。

人类对四维或更高维度深刻理论理解目前受限于人类自身基于二维视网膜构建的三维视觉系统。 事实上,人眼也是一种二维传感器,我们人类对三维世界的理解也是大脑后期空间计算制作的结果。 三维成像显示系统通过向观看者的眼睛呈现两个略有不同的图像来模拟构建三维。这些图像对齐以匹配每只眼睛的不同视角,创造出深度感。裸眼三维需要两个垂直的二维显示屏也是人为强化在两个眼睛中的视角区分度从而在二维屏幕上模拟产生更为逼真的三维既视感。 在没有真正三维视觉视网膜的情形下,高维理念是否可以被只有二维视网膜的三维人类所真切体验理解?建立完成高维度的数理理论框架是否是限于3D维度的人类智能不可触及的天花板? 著名的四色地图问题仍旧没能在已有数学框架下证明,而是依靠数千小时的计算机计算得以勉强证明,也佐证了空间计算可能是另一条深度理解视觉原理的蹊径。人类目前作为三维生物,可以很容易证明理解一维两色地图问题。继续在二维流形面上地图分割,类推则可能需要增加一个维度的四维生物才能对二维四色地图问题有更深刻理解,并完成纯逻辑数学证明。空间计算也可能更容易揭示或帮助人类理解一些未知全息存在维度的存在与否。分形数学产生的德布洛大佛,也有很多局部小佛,一定程度揭示每个人类个体可能是高维存在形式的分形或全息。如果全息假说成立,空间智能计算获得的空间意识智能将缺少把宇宙全息理解的渠道引入的机制, 空间计算的进步可以不停逼近人类对三维空间的理解,但基于人工智能的空间计算和空间意识可能如女娲捏出的泥人般,如果缺少女娲集天地自身全息灵气吹出的那口仙气, 只能形似,而不能真正神似。

图二:武汉市汉阳区一处裸眼三维模拟显示器广告牌 [8]。

空间智能计算并不需要完全模仿人类视觉系统,完全可以另辟蹊径帮助理解人类视觉系统和互补人类视觉系统所不能实现的功能,为人类开辟高维度文明视角理解世界。 如同人类不需要完全模仿鸟类去设计飞机,虽然人类的飞机灵活性不如普通鸟类,但飞行高度和速度却可以超过所有鸟类。 尽管没有真正的三维传感器直接获取同一时间的三维信号, 但空间计算却可以构建出三维和仿真出四维视角展示我们的三维世界。生命的视觉从开始三维体验到目前高度发达的视觉经历了5亿年的不断进化,虽然目前空间计算无法接近人类大脑的三维空间呈现,如2024 发布的Apple Vision Pro 需要12 毫秒延迟才能向眼睛显示外部摄像头在眼镜外看到的视野,即使设置到最高质量模式仍然无法达到多数用户的自然渲染画质期望。 另一方面,空间计算第一次给人类三维之外的新视角,可以为我们提供自然视觉系统无法提供的四维体验。增强现实实际上用高能耗高维度的计算将同是三维的两个或多个坐标系(也可以认为是两个平行的三维宇宙坐标系统)合并在一个眼镜佩戴者观察的真实世界中, 提供一个近似让人类以四维生物视角理解三维平行世界的解决方案。 数字孪生是物理对象、人或过程的1:1 的数字表示。数字孪生可以帮助增强现实(AR)模拟真实情况及其结果,最终使其做出更好的决策。基于数字孪生的空间计算可以帮助人类构建高维度对现实和虚拟世界进行平行跨越和提供1+1>2 的增强理解,开始为人类展示高于三维更深刻的高维体验和帮助人类建立高维数理直觉。增强现实可以通过计算将虚拟空间三维高分辨率的数字孪生模型引入现实世界,实现完成一些四维生物级别对三维世界物体的操作和可视化。 例如用户可以与虚拟对象进行交互,完成多个不同三维世界的信息切换。 使用者以近乎四维生物的视角,观察到现实三维实物内部不可见信息的全息呈现和人脑从未体验的四维操控效果。带上AR眼镜后, 用户可以实时将虚拟三维数字孪生模型从混合现实场景中瞬间移除,如同平面国小说(Flatland: A Romance of Many Dimensions) 所描述三维球带走一个二维的方物体居民到三维空间而平面国的二维居民完全无法知晓理解移除过程。 如下图的增强现实医学应用, 医生可以从高维度视角新增的维度,看到低维度视角无法看到的任意视角切面的三维实物内部或病人透明的全信息显示,也可以从新增维度取走或加入物体,而不被低纬度感知这个变化的轨迹过程。在三维场景内看来,物件如凭空突然消失或加入。实际上,只是AR眼镜使用者的“上帝之手”在场景外另一维度的软件界面操作或手势对全息数字孪生模型的自如操控。

图三:增强现实辅助手术展示 [9] 。

为什么空间智能计算尽管存在技术瓶颈,依然是未来之星并直接关乎未来人工智能时代是否造福人类的关键必经之路?

怎样找到现实和虚拟世界对应物品空间坐标系匹配的仿射变换 (Affine Transformation),是一个极具挑战的工程问题。核心难题是两个坐标定义系统的相关性挖掘和匹配问题,以及低能耗高分辨率可靠的同步照相机定位和空间地图创建(SLAM)问题的工程实现。相关关联对应点准确配对的情况下, 可以直接用奇异值分解(SVD)得到分析解。 当对应点配对不确定, 1994年张正友教授提出的迭代最近距离点匹配算法 (ICP) 依然目前是最好最广泛的通用算法。可以在给定较优起始六個自由度误差较小的情况下,动态完成对应点的最大似然匹配最优解。 由于ICP本身的目标函数是根据目前多个最近距离点集作为对应点配对集计算出来,下一对应点配对集又由当前目标函数所导出产生。 选择迭代动态对应点的标准,本身取决于前一迭代对应点配对集,如同先有鸡和先有鸡蛋的深耦合迭代问题,最后匹配过程是对初始条件敏感而不适定(ill-posed)的。 深度信息目前的误差远大于图像RGB像素,深度像素分辨率也远低于图像分辨率, 很多现实世界数据质量(初始姿态对算法产生的歧义解,对应点部分缺失,噪声水平和空间信号扭曲等等)限制了最后的匹配准确度[10]。 用户应用中增强现实的视野的调试需要会造成起始状态视角不确定误差, 对算法鲁棒性要求非常高。 当一个点云只是另一点云的子集合, 配准解只是局部最优解的情况下,则需要随机移动小点云在大点云上各个区域才能给出全局最优近似解,这种方法可能增加成百上千倍的计算时间,同时由于缺乏对应点基准真实配对信息,没有一个基准可以确保能选出全局最优分析解,最终只能是经验指导的最大似然解,这些都直接影响用户体验感和实时真实性[11]。

同时定位与地图构建(SLAM)的生物实现机制由于视觉与大脑的紧密联系并不完全清楚。 相机的稳定性在鸟类和哺乳类有异曲同工的两个高于目前人类目前SLAM算法的解决方案。 鸟类头部稳定性极高,鸟类空间运动速度快, 在飞行中拥有一个稳定的视线,便于预防天敌和寻找食物。 同时鸟类眼睛高度发达,眼睛占据眼眶,没有灵活肌肉空间,因此主要依靠颈部肌肉维持头部位置和视野稳定。 例如鸡或者鸽子采取脖子不断前后运动的点头行走方式稳定视野, 把摄像头放在鸡头上的防抖摄像鸡在高速运动时帮助摄影师得到更稳定的视频画质。人类和哺乳动物则是靠眼睛与脑部运动负反馈补偿来稳定视野。 生物视觉系统中这些实时高精确度高稳定度的动态空间计算理解远超人类目前在计算机视觉中实现的SLAM 算法。人眼实时获取高分辨景深(左右半脑视网膜神经元不能直接联系)的同时也高效率实时完成这些对应区域的动态矫正是目前在工程学上无法媲美实现的。大脑可以轻松创建和使用具有数理信息洞察力、可操作性和紧凑性的空间环境模型,而现有的人工SLAM系统远不能实时构建与可与人脑空间意识相比的模型。

SLAM目前的算法挑战, 动态不稳定可以叠加的错误使SLAM不能在安全要求高的应用中满足需要,阻碍增强现实和虚拟现实成为主流广泛应用。目前SLAM估计运动物体自身位置和周围地标位置得到最大似然优化解,需要在多个局域短期不确定中整合为合适的全局长期最大确定性解,因此也非常局限于初始帧的状态和所选择的坐标系。初始条件的微小变化都可能会产生最终定位的巨大差异。由于每一帧的错误可以积累传播到下一帧,在不连续几何曲度(如楼梯等)和图像特征分辨率和相关识别不理想的情况下,无法长期保持可接受的置信正确度。调整帧与帧空间坐标系连续关系的正确性依赖于照相机自身位置的正确性,而照相机新的位置又同时由周围环境多帧的特征和之前照相机位置来计算得出,因此也是一个鸡先蛋先互相依存的高耦合迭代优化过程。 由于并不是每一帧都有高置信特征帮助定位和确定帧与帧之间的运动关系,及多模问题本有的不稳定混沌性, 在工程学上即使在一定间隔高置信的帧进行动态阶段性矫正,仍然无法实现长时间多场景可满足精确度要求的SLAM工程解决方案。 日常生活中的鼠标可以帮助我们理解这一过程的挑战。 鼠标采样区域用2000 像素在紧贴鼠标的垫子上一两个平方毫米内产生高清纹理图像来定位和移动方向,在如此高分辨率的图像下, 鼠标在光滑光学较均质的平面也会无法确定两帧直接的相对运动方向而失灵。 同样,AR眼镜传感器离现实物件约12米, 空间像素分辨率远远低于鼠标 , 会出现找不到特征匹配而丢帧,不能在两帧间找到纹理特征联系 (如均质墙面),导致远比鼠标表现更差的稳定性和相机相对运动误差。

未来可望通过空间智能计算最终解决通用空间定位SLAM的解决方案。 2024年大语言通用模型突破的一个根本原因是互联网几乎完整记录了人类整个语言文本知识体系,语言本身也比空间形态稳定性更高。斯坦福大学李飞飞教授通过人工标定分类整个互联网图片建立被机器视觉领域广泛使用的最大二维图像ImageNet数据库 [12], 直接帮助之后深度神经网络理解二维图像和一维语言文本的内在关系并获得在二维图像人工智能分类接近和超越人类通过人机图灵测试的巨大成功。未来机器人空间智能成功的关键也应该是建立地球3D几何形态大数据库,训练通用空间智能模型达到三维物理现实空间与人类语言抽象模型关联的深刻理解。目前因为缺少人类关联的3D几何形体空间的大数据基础,同时也因为三维图形CAD制图是公司少数设计工程师的企业行为,基本不对公众公开, 导致训练三维通用几何形体模型缺少足够的数据支持。 三维通用几何形体模型和自主人形机器人的动态训练将是真正工程上解决匹配点和SLAM的重要方向。目前希望通过空间智能解决空间定位的这个挑战,从而帮助大通用三维模型学习提高空SLAM精度和场景理解。因为三维照相机, 机器人,自动驾驶和AR没有大范围使用, 从而缺少通用公开的元宇宙三维数据共享网络和大几何数据库。随着机器人和自动驾驶与人类的互动,可以采集足够多空间数据,不断迭代训练通用大空间模型,提高自动驾驶(室外空间)和自主机器人(室内空间)提高对空间的理解水平和应用范围,进而可以采集更高质量的三维空间信息,在多次迭代后,真正实现通用空间智能和人形机器人的共同进步。 最终机器人可以完成人类可以完成的绝大多数工作,真正实现机器人和人类混合地球智能文明 [13]。

总的来说,AR技术有很多应用前景,但是在实现中需要解决一些挑战去迎接未来人类混合文明的新机遇。 这些挑战需要AR技术的开发者和研究者共同解决,以提高AR技术的实用性和用户体验。AR技术目前无法提供人眼人脑结合的真实三维景深感,某些场景中可能需要用户进行额外的操作或调整。空间智能计算需要使用计算机视觉算法来检测目标对象或环境,但是在某些缺少特征变化的场景中,对繁杂甚至改变的背景 ,光照 ,形状的目标对应点检测需要经典算法上或大空间智能的新突破。同时由于能耗考虑和技术限制,没有足够的显示空间或图像处理性能提供接近人眼超视角的无缝体验。为提高空间计算设备的接受度,需要进一步减低硬件成本和优化用户体验,建立标准化3D空间计算数据, 为空间智能通用模型进步提供非监督训练的标准3D空间大数据支持 。 三维眼镜和AR技术的未来不仅仅在于增强了娱乐性,还在于它增强了在各个领域身临其境、互动和个性化的体验。随着技术的不断发展,它有望进一步模糊虚拟数字世界和物理世界之间的界限,提供感知、理解环境以及与环境互动的新方法, 构建一个机器人自主学习现实三维空间的非监督空间学习平台。机器人模拟三维空间中的模拟算法同时帮助我们更好的揭示对外在空间的理解,以及在空间里的自主决策和初等意识形成建立的关系,为我们在机器人的自主空间世界加入安全护栏,给人工智能自主划定安全的空间边界,确保自主机器人永远是在为人类服务的安全空间内。 继往开来,全球三维传感器市场发展势头极为强劲。根据知识市场洞察研究的《2021-2025年三维 sensing行业深度市场调研及投资策略建议报告》, 2021 年全球 三维 传感市场规模为 27 亿美元,预计到 2028 年将达到 100 亿美元以上,2021 年至 2028 年复合年增长率为 28.15%。与三维传感器紧密相关的机器人和自动驾驶汽车一般是三维传感器价格的百倍以上。万亿美元产业效应和人类对未来空间意识智能进一步认识的探索需求,必然将空间计算的挑战转变为如空间一样有无限可能的机遇! 地球上将第一次产生作为人类助手并共存于人类社会的人形机器人生态族群 。人形机器人与生物人类共存的混合母星文明阶段最终实现也将同时为地球人在人形机器人的帮助下以地球混合母星文明为模版实现火星上的自主长期生存,最终为跨母星文明的到来,提供坚实的技术后盾。

参考资料:

[1] 大爆炸 https://zh.wikipedia.org/wiki/大爆炸

[2] 寒武纪大爆发 https://zh.wikipedia.org/zh-hans/寒武纪大爆发

[3] 李兆平, “人的眼睛为什么如此擅长抓重点”,《环球科学》(科学美国人中文版) 2016

[4] 左超 ,张晓磊,胡岩,尹维,沈德同,钟锦鑫,郑晶,陈钱, “3D 真的来了吗?— 三维结构光传感器漫谈”, 红外与激光工程 Vol.49 No.3 2020

[5] Shapson-Coe, A., Januszewski, M., Berger, D.R., et al.: A petavoxel fragment of human cerebral cortex reconstructed at nanoscale resolution, Science Vol 384, Issue 6696, 2024

[6] 大脑怎么“看见”世界的——视觉系统https://www.sohu.com/a/100939914_297710 2016

[7] Despite Owning VR Headsets, Teenagers Aren’t Using Them, Study Suggests (msn.com) 2024

[8]武汉:裸眼3D屏“三镇之眼”亮相汉阳https://m.cyol.com/gb/articles/2022-10/07/content_BX4elclYb.html 视觉中国 , 2022

[9]ADARIO S., “Microsoft's HoloLens 2 Team Answers More Questions About Biometric Security, Audio, & Hand Tracking” https://hololens.reality.news/news/microsofts-hololens-2-team-answers-more-questions-about-biometric-security-audio-hand-tracking-0194712/ 2019.

[10] Zhang Z Iterative point matching for registration of free-form curves and surfaces. Int J Comput Vis 13(2):119–152. Also Research Report No.1658, INRIA Sophia-Antipolis, 1994.

[11] Xiaoshui H. , Guofeng M. and Jian Z. “Cross-source Point Cloud Registration: Challenges”, Progress and Prospects arXiv:2305.13570, 2023.

[12] Deng J, Dong W, Socher R, Li L-J, Li K, Fei-Fei L. Imagenet: A large-scale hierarchical image database. In: 2009 IEEE conference on computer vision and pattern recognition. p. 248–55. 2009.

[13] SLAM的过去现在和未来:稳健感知时代https://zhuanlan.zhihu.com/p/471184443 2022.